Coup de fil de la Production : “C’est quoi votre format ?”

– Euh, vous voulez parler du ratio image ? On est en 1,77.

– Mais non, votre format d’enregistrement ?

– Le codec utilisé ? Nous sommes en ProRes 4:4:4:4 XQ.

– Oui, ça on sait mais votre format ? C’est du 2K ou du 3,2K ?

– Ah, notre définition ! Et bien, on est en 3,2K.”

Dialogue apparemment absurde et caricatural ? Et pourtant, déjà vécu moult fois.

De nos jours, plus personne ne s’y retrouve. Format d’enregistrement, format d’image, format de capteur, format de montage… De la mise en scène à la post prod en passant par certains chefs opérateurs, la confusion des genres n’est jamais loin. Même les constructeurs de caméras et les développeurs de logiciels s’y mettent en indiquant leurs formats de signal vidéo disponibles ou requis dans les spécifications techniques de leurs produits, qui n’ont pas forcément de rapport entre différentes sociétés…

Et qui mieux que nous, assistants caméra, pour montrer l’exemple et tenter de faciliter la communication autour de ce terme employé à tort et à travers ?

Tout d’abord, mieux vaut l’oublier définitivement. “Format” est un mot-valise dans lequel on vient fourrer plusieurs notions liées à l’image. Il est donc important de redéfinir les termes en appelant un chat un chat. Le but n’étant pas de refaire l’explication, ni l’historique des termes adéquates, mais juste de remettre un peu à plat les choses.

C’est quoi ton format de cadrage ? • LE RATIO

Utilisé par les réalisateurs ou les chefs op, le mot Format fait souvent référence au ratio. Un nombre à virgule résultant d’une division de la largeur par la hauteur de l’image, on parle de rapport largeur/hauteur. (Parfois même la division elle-même suffit pour donner un ratio, comme le 16:9 pour 1,77 ou le 4:3 pour 1,33)

Aux débuts du cinéma, le ratio s’est défini de lui même par les dimensions de la pellicule (largeur) et du nombre de perforations (hauteur) utilisées pour créer une image.

Mais très vite en argentique (avec l’aperture gate) comme maintenant en numérique, il a été possible de choisir son ratio, voire même d’en créer de nouveaux ! Le ratio est aussi un outil artistique de mise en scène, en effet la composition des images n’est plus la même lorsque le cadre est plus large ou étroit.

Quelques ratios connus : 1,33 ; 1,77 ; 1,85 ; 2,40 et plus récemment 2,00 (ratio prôné par Vittorio Storaro depuis 1998).

C’est quoi ton format de capteur ? • LA DÉFINITION

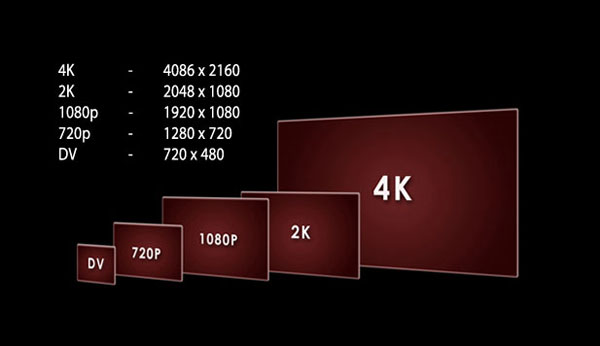

C’est le nombre de pixels en numérique ou la taille concrète de la pellicule en film. La haute définition HD (1920 x 1080 pixels) est aujourd’hui dépassée par le 4K (4 096 × 2 160 pixels) et plus. En pellicule, on tourne avec du 35mm (de large), du 16mm, du 70mm…

Attention, le “nombre de pixels” ne veut pas dire “grandeur d’image”. Il faut bien différencier la taille physique du capteur et le nombre de pixels. Un exemple est la Weapon Helium qui a une taille de capteur S35 et une définition de 8K. Hors la Weapon Vistavision a un capteur taille Vistavision et une définition de 8K aussi.

Quelques définitions numériques connues : HD ; 2K ; 3,2K ; 4K ; 5K…

C’est quoi ton format de tournage ? • LA FRÉQUENCE

C’est le nombre d’images enregistrées par seconde (autrement dit la vitesse de tournage).

24 i/s au cinéma, 25 i/s à la TV en France.

P pour progressif, une image à la fois. I pour entrelacé, rapport aux deux demi-trames nécessaires sur un écran de TV pour constituer une image sans effet de papillonnement, sans augmenter le débit et en se basant sur la fréquence électrique domestique de 50Hz. Aux États-Unis, la fréquence domestique de 60Hz impose des normes différentes (30 i/s). Une erreur dans le choix de la fréquence du projet au tournage peut être fatale en post prod !

L’entrelacement est un héritage historique : les nouvelles technologies TV permettent depuis plusieurs années de s’en affranchir.

C’est quoi ton format de fichier ? • LE CONTENEUR

En numérique, il s’agit des quelques lettres suivant un point dans la dénomination d’un fichier numérique (.avi, .mpeg, .mov, .mp4, .r3d …). On parle aussi d’extension de fichiers.

Un fichier vidéo est fait de deux composantes : le codec et le conteneur. Tandis que le codec est la “langue parlée” par le fichier (AVC-Intra, ProRes, MPEG-2…), le conteneur est le véhicule de ce fichier (.mov, .mp4, .avi…). Le conteneur permet de stocker le fichier en séquençant d’une manière précise tous ses composants (son, image, sous titres, métadonnées..). Ainsi, dire qu’on a un fichier .mov ne suffit pas à donner sa nature. Le codec utilisé dedans est-il du ProRes ou du H264… ?

Codec et conteneurs sont souvent liés par leur constructeur. Par exemple Apple a développé le ProRes, un codec décliné sous de nombreuses caractéristiques, dont le conteneur est .mov.

Dans le même exemple, le codec H264 ou MPEG2 peut être contenu dans un .mov, .avi, .mp4…

C’est quoi ton format de ficher (suite) ? • LE CODEC

C’est l’algorithme permettant de lire, et la plupart du temps, de compresser un flux vidéo, développé par une société privée ou un groupe d’experts (comme le MPEG) développant des normes internationales. Par exemple, nous avons chez Sony le XAVC, chez Apple le ProRes, et des normes comme le MPEG2 (MPEG) et DNXHD (SMPTE). En ce qui concerne l’assistant caméra, il est important de vérifier que le choix du codec sera harmonieux sur toute la chaine du workflow : en tenant compte du constructeur de la caméra, de l’utilisation souhaitée des fichiers sur le plateau et des logiciels utilisés en post prod. Encore une fois, il faudra faire attention au stockage disponible selon le codec choisi. Un codec vidéo est défini par plusieurs caractéristiques comme son constructeur mais aussi l’échantillonnage et la quantification, qui font augmenter la taille du fichier vidéo final.

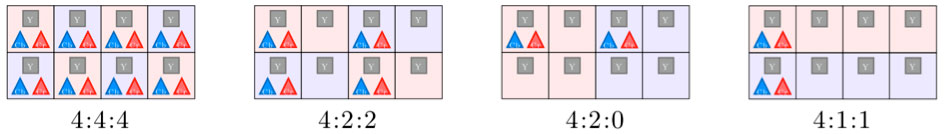

C’est quoi ton format d’échantillonnage ? • L’ÉCHANTILLONNAGE

Appelé aussi le mode de traitement, c’est la manière de compresser le flux grâce à la répartition de la couleur (chrominance) et l’intensité lumineuse (luminance) dans les pixels. On utilise pour cela la moindre sensibilité de l’œil humain à la couleur par rapport au contraste, et en calculant le vert à partir de la différence entre le bleu et le rouge.

Il existe plusieurs structures. Le 4.2.2 (4 pixels de luminance, 2 de Bleu, 2 de rouge), le 4.2.0 (4 pixels de luminance, 1 pixel de couleur…)

Le RAW peut être vu comme un mode de traitement dans le sens où tous les pixels contiennent le maximum d’information de chrominance (bleu, rouge et vert) et de luminance, sans compression. Mais attention, tous les constructeurs utilisent un codec propriétaire pour leur RAW, (arriraw, redcode, F55RAW pour sony…). Donc même en RAW il y a une notion de codec puisque, avec ou sans compression, les images sont encapsulées et arrangées selon un codec ou un autre.

C’est quoi ton format de quantification ? • LA QUANTIFICATION

C’est la méthode de « récolte » des informations de couleur et d’intensité lumineuse de chaque pixel, mesurée en « bit ». On code ces informations sur une échelle d’intensité électrique de 8, 10, 12, 14 ou 16 bits. Plus l’échelle est grande, et plus le nombre de nuances de couleurs est grand, à la puissance de 2.

28 = 256 / 210 = 1 024 / 212 = 4 096 / 214 = 16 384 / 216 = 65 536…

On parle de profondeur des couleurs ou de nuances des couleurs d’une image.

C’est quoi le format de ton film ? • LA DURÉE

Hé oui ! pour peu qu’on travaille en TV, on aura peut être affaire au mot format pour la diffusion du programme, pour un 52 minutes ou un 90 minutes par exemple.

J’espère avoir fait le tour de la question, et qu’on ne me parle plus de format !